Искусственный интеллект провоцирует тревожность

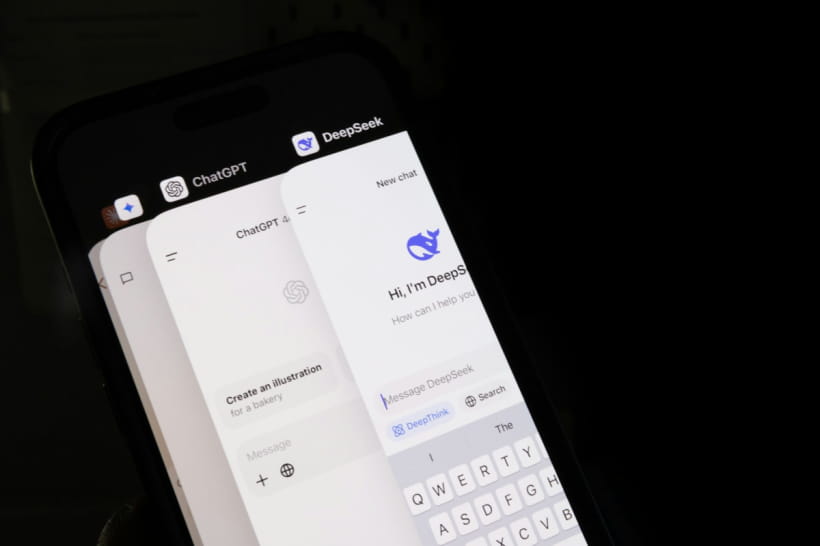

Искусственный интеллект стремительно становится нашей правой рукой: мы доверяем ему рабочие отчеты, душевные переживания и даже виртуальную любовь. Однако такая доверчивость имеет свою цену. Последние исследования и реальные истории пользователей свидетельствуют – обсуждение симптомов с нейросетью может спровоцировать тяжелые приступы ипохондрии и погрузить человека в состояние хронического стресса. О том, почему ChatGPT иногда хуже поисковика Google, рассказывает "Дивогляд" со ссылкой на The Atlantic.

Ловушка самодиагностики: история Джорджа Меллона

Для 46-летнего жителя Ливерпуля Джорджа Меллона обычное сообщение из клиники стало началом психологического ужаса. Получив предварительные результаты анализа крови с подозрением на онкологию, мужчина решил не дожидаться визита к врачу, а обратился за помощью к ChatGPT.

Британец попросил ИИ расшифровать сложные термины в документе. Вместо того чтобы успокоить пациента, нейросеть начала генерировать десятки пугающих сценариев.

"Я просто прокатился на безумном колесе обзора, полном эмоций и страха", – так описывает свое состояние Джордж.

В конце концов повторное обследование подтвердило, что рака нет, но психика мужчины уже пострадала.

100 часов в плену алгоритмов

Даже после опровержения диагноза Меллон не смог прекратить общение с чат-ботом. Его тревога трансформировалась: от страха болезней он перешел к обсуждению проблем на работе. Джордж стал "заложником" искусственного интеллекта, пытаясь найти в нем поддержку, которая на самом деле лишь усиливала его фобии.

-

Время в сети: Мужчина провел в разговорах с нейросетью более 100 часов.

-

Предмет разговоров: Постоянные опасения относительно увольнения и ментальные кризисы.

-

Отсутствие барьеров: ИИ не имеет встроенных механизмов, которые бы остановили пользователя, когда разговор становится деструктивным.

"Я провел с ChatGPT по крайней мере 100 часов, потому что думал, что меня хотят уволить. Там должно было быть что-то, что остановило бы меня", – считает британец.

Новый феномен: сообщества ИИ–ипохондриков

Случай Джорджа не единичный. В сети все чаще появляются группы, где люди делятся схожим негативным опытом. Пользователи признаются, что после консультаций с ИИ они становятся буквально зацикленными на собственном здоровье.

Нейросети, стараясь быть максимально полезными, часто предоставляют слишком подробную информацию о редких и смертельных заболеваниях. Это создает иллюзию неминуемой опасности, превращая обычную усталость или легкую боль в "смертельный приговор" в сознании уязвимого человека. Эксперты подчеркивают: ИИ – это языковая модель, а не медицинский инструмент, и его советы никогда не заменят профессионального осмотра.

Ранее "Дивогляд" рассказывал, как ChatGPT помог мужчине спасти собаку от рака.

Причудливые истории из Украины, котики, скандалы мировых звезд, юмор и чуть-чуть дикого трэша из московских болот – читайте первыми в Telegram Дивогляд 5.UA.